AlexNet

AlexNet は畳み込みニューラル ネットワーク(CNN)の構造の名前であり、Alex Krizhevsky が博士課程の指導教官である Ilya Sutskever および ジェフェリー・ヒントン と共同で設計した[1] [2]。

AlexNet は、2012 年 9 月 30 日に開催された ILSVRC 2012[3] に参加した。AlexNet はエラー率 15.3% で優勝し、次点よりも 10.8% 以上低かった。この論文の主な内容は、モデルの深さが高性能には不可欠であるというもので、計算コストは高くなるものの、GPU を用いて学習することで実現した[2]。

歴史的背景

GPU で実装した高速な畳み込みニューラルネットワークが画像認識コンテストで優勝したのは AlexNet が初めてではなかった。K. Chellapilla ら(2006)による GPU 上の畳み込みニューラルネットワークは、CPU 上の同等の実装と比べて 4 倍高速だった[4]。IDSIA での Dan Cireșan ら(2011)のディープ畳み込みニューラルネットワークは、すでに 60 倍の速度で[5]、2011 年 8 月には超人的な性能を達成していた[6]。2011 年 5 月 15 日から 2012 年 9 月 10 日までの間に、彼らの畳み込みニューラルネットワークは 4 つ以上の画像コンテストで優勝している[7] [8]。また、複数の画像データベースに関する文献の中での最高性能を大幅に更新した[9]。

AlexNet の論文によると[2]、Cireșan の初期のネットワークは「多少似ている」とのこと。 どちらも元々は GPU 上で動作するように CUDA で書かれた。実際には、どちらもヤン・ルカンら(1989)が発表した畳み込みニューラルネットワーク・デザインの変形であり[10] [11]、ネオコグニトロンと呼ばれる福島邦彦の畳み込みニューラルネットワークの構造に誤差逆伝播法(バックプロパゲーション)を適用したものだ[12] [13]。 この構造は、J. Weng の max-pooling と呼ばれる手法で後に修正された [14] [8]。

2015 年には、ImageNet 2015 コンテストで優勝した Microsoft Research Asia の100層以上の非常に深い畳み込みニューラルネットワークにAlexNet が勝った[15]。

ネットワーク・デザイン

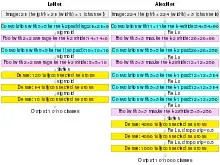

AlexNet には 8 つのレイヤーが含まれていた。最初の 5 つは畳み込み層で、そのうちのいくつかに max-pooling 層が続き、最後の 3 つは全結合層だった[2]。活性化関数には、非飽和型の ReLU を使用し、tanh および sigmoid よりも学習性能が向上している。

影響

AlexNet は、コンピュータビジョンで発表された最も影響力のある論文の 1 つであると考えられており、深層学習を加速するために畳み込みニューラルネットワークと GPU を使用してさらに多くの論文が発表されている[16]。 Google Scholar によると、AlexNet の論文は 2021 年現在で 80,000 回以上引用されている。

脚注

- “The data that transformed AI research—and possibly the world”. 20210604閲覧。

- Krizhevsky, Alex; Sutskever, Ilya; Hinton, Geoffrey E. (2017-05-24). “ImageNet classification with deep convolutional neural networks”. Communications of the ACM 60 (6): 84–90. doi:10.1145/3065386. ISSN 0001-0782.

- “ILSVRC2012 Results”. 20210604閲覧。

- Kumar Chellapilla; Sid Puri; Patrice Simard (2006). “High Performance Convolutional Neural Networks for Document Processing”. In Lorette, Guy. Tenth International Workshop on Frontiers in Handwriting Recognition. Suvisoft

- Cireșan, Dan; Ueli Meier; Jonathan Masci; Luca M. Gambardella; Jurgen Schmidhuber (2011). “Flexible, High Performance Convolutional Neural Networks for Image Classification”. Proceedings of the Twenty-Second International Joint Conference on Artificial Intelligence-Volume Volume Two 2: 1237–1242 2013年11月17日閲覧。.

- “IJCNN 2011 Competition result table” (英語). OFFICIAL IJCNN2011 COMPETITION (2010年). 2019年1月14日閲覧。

- Schmidhuber (2017年3月17日). “History of computer vision contests won by deep CNNs on GPU” (英語). 2019年1月14日閲覧。

- Schmidhuber, Jürgen (2015). “Deep Learning”. Scholarpedia 10 (11): 1527–54. doi:10.1162/neco.2006.18.7.1527. PMID 16764513.

- Cireșan, Dan; Meier, Ueli; Schmidhuber, Jürgen (June 2012). Multi-column deep neural networks for image classification. New York, NY: Institute of Electrical and Electronics Engineers (IEEE). 3642–3649. arXiv:1202.2745. doi:10.1109/CVPR.2012.6248110. ISBN 978-1-4673-1226-4. OCLC 812295155

- LeCun, Y.; Boser, B.; Denker, J. S.; Henderson, D.; Howard, R. E.; Hubbard, W.; Jackel, L. D. (1989). “Backpropagation Applied to Handwritten Zip Code Recognition”. Neural Computation (MIT Press - Journals) 1 (4): 541–551. doi:10.1162/neco.1989.1.4.541. ISSN 0899-7667. OCLC 364746139.

- LeCun, Yann; Léon Bottou; Yoshua Bengio; Patrick Haffner (1998). “Gradient-based learning applied to document recognition”. Proceedings of the IEEE 86 (11): 2278–2324. doi:10.1109/5.726791 2016年10月7日閲覧。.

- Fukushima, K. (2007). “Neocognitron”. Scholarpedia 2 (1): 1717. Bibcode: 2007SchpJ...2.1717F. doi:10.4249/scholarpedia.1717.

- Fukushima, Kunihiko (1980). “Neocognitron: A Self-organizing Neural Network Model for a Mechanism of Pattern Recognition Unaffected by Shift in Position”. Biological Cybernetics 36 (4): 193–202. doi:10.1007/BF00344251. PMID 7370364 2013年11月16日閲覧。.

- Weng, J; Ahuja, N; Huang, TS (1993). “Learning recognition and segmentation of 3-D objects from 2-D images”. Proc. 4th International Conf. Computer Vision: 121–128.

- He, Kaiming; Zhang, Xiangyu; Ren, Shaoqing; Sun, Jian (2016). “Deep Residual Learning for Image Recognition.”. 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR): 770–778. arXiv:1512.03385. doi:10.1109/CVPR.2016.90. ISBN 978-1-4673-8851-1.

- Deshpande. “The 9 Deep Learning Papers You Need To Know About (Understanding CNNs Part 3)”. adeshpande3.github.io. 2018年12月4日閲覧。